范文一:3 回归方程及回归系数的显著性检验 1

3 回归方程及回归系数的显著性检验

1

,、回归方程的显著性检验

(1) 回归平方和与剩余平方和

建立回归方程以后, 回归效果如何呢,因变量与自变量是否确实存在线性关系呢,这是需要进行统计检验才能加以肯定或否定, 为此, 我们要进一步研究因变量取值的变化规律。的每次取值是有波动的, 这种波动常称为变差, 每次观测值的变差大小, 常用该次观侧值与次观测值的平均值的差(称为离差)来表示, 而全部次观测值的总变差可由总的离差平方和

,

其中:

称为回归平方和, 是回归值与均值之差的平方和, 它反映了自变量

的变化所引起的的波动, 其自由度(为自变量的个数)。

称为剩余平方和(或称残差平方和), 是实测值与回归值之差的平方和, 它是由试验误差及其它因素引起的, 其自由度。总的离差平方和的自由度为

。

如果观测值给定, 则总的离差平方和是确定的, 即是确定的, 因此大则小, 反之, 小则大, 所以与都可用来衡量回归效果, 且回归平方和越大则线性回归效果越显著, 或者说剩余平方和越小回归效果越显著, 如果,0, 则回归超平面过所有观测点; 如果大, 则线性回归效果不好。

(2) 复相关系数

为检验总的回归效果, 人们也常引用无量纲指标

, (3.1)

或

, (3.2)

称为复相关系数。因为回归平方和实际上是反映回归方程中全部自变量的“方差贡献”, 因此就是这种贡献在总回归平方和中所占的比例, 因此表示全部自变量与因变量的相关程度。显然。复相关系数越接近,, 回归效果就越好, 因此它可以作为检验总的回归效果的一个指标。但应注意, 与回归方程中自变量的个数及观测组数有关, 当相对于并不很大时, 常有较大的值, 因此实际计算中应注意与的适当比例, 一般认为应取至少为的,到10倍为宜。

(3) 检验

要检验与是否存在线性关系, 就是要检验假设

, (3.3)

当假设成立时, 则与无线性关系, 否则认为线性关系显著。检验假设应用统计量

, (3.4)

这是两个方差之比, 它服从自由度为及的分布, 即

, (3.5)

用此统计量可检验回归的总体效果。如果假设成立, 则当给定检验水平α下, 统计量应有

?, (3.6)

对于给定的置信度α, 由分布表可查得的值, 如果根据统计量算得的值为

, 则拒绝假设, 即不能认为全部为O, 即个自变量的总体回归效果是显著的, 否则认为回归效果不显著。

利用检验对回归方程进行显著性检验的方法称为方差分析。上面对回归效果的讨论可归结于一个方差分析表中, 如表3.1。

表3.1 方差分析表

来自由平方和 方 差 方差比

源 度 回

归 剩 余 总 计 根据与的定义, 可以导出与的以下关系:

,

。

利用这两个关系式可以解决值多大时回归效果才算是显著的问题。因为对给定的检验水平α, 由分布表可查出的临界值, 然后由即可求出的临界值:

, (3.7)

当时, 则认为回归效果显著。

范文二:回归方程及回归系数的显著性检验

?3 回归方程及回归系的归著性归归数

,、回归方程的归著性归归

(1) 回归平方和剩余平方和与

建立回归方程以后, 回归效果如何,因归量呢与自归量是否归存在归性归系,归是需要归行确呢

归归归归才能加以肯定或否定, 归此, 我归要归一步究因归量研取归的归化归律。的每次取归是有波归的, 归归波归常归归差称, 每次归归归的归差大小, 常用归次归归归与次归归归的平均归的差(归归差称离)表示来, 而全部次归归归的归归差可由归的差平方和离

,

其中:

称归回归平方和, 是回归归与均归之差的平方和, 反映了自归量它的归化所引起的的波归, 其自由度(归自归量的个数)。

称归剩余平方和(或差平方和称残), 是归归归与回归归之差的平方和, 是由归归归它差及其因素引起的它, 其自由度。归的差平方和离的自由度归。 如果归归归归定, 归归的差平方和离是定的确, 即是定的确, 因此大归小, 反之, 小归大, 所以与都可用衡量回归效果来, 且回归平方和越大归归性回归效果越归著, 或者归剩余平方和越小回归效果越归著, 如果,0, 归回归超平面归所有归归点; 如果大, 归归性回归效果不好。

(2) 归相归系数

归归归归的回归效果, 人归也常引用无量归指归

, (3.1)

或

, (3.2)

称数归归相归系。因归回归平方和归归上是反映回归方程中全部自归量的“方差归”献, 因此就是归归归在归献回归平方和中所占的比例, 因此表示全部自归量因归量与的相归程度。归然。归相归系越接近,数, 回归效果就越好, 因此可以作归归归归的回归效果的一指归。但归注意它个, 与个数回归方程中自归量的及归归归数有归, 当相归于并很不大归, 常有归大的归, 因此归归归算中归注意与的适比例当, 一般归归归取至少归的,到10倍归宜。

(3) 归归

要归归与是否存在归性归系, 就是要归归假归

, (3.3)

当假归成立归, 归与无归性归系, 否归归归归性归系归著。归归假归归用归归量 , (3.4)

归是方差之比两个, 服自由度归它从及的分布, 即

, (3.5)

用此归归量可归归回归的归效果。如果假归体成立, 归归定归归水平当α下, 归归量归有 ?, (3.6)

归于归定的置信度α, 由分布表可归得的归, 如果根据归归量算得的归归,

归拒归假归, 不能归归全部即归O, 即个体自归量的归回归效果是归著的, 否归归归回归效果不归著。 利用归归归回归方程归行归著性归归的方法归方差分析。上面归回归效果的归归可归归于一方差分析表中称个, 如表3.1。

表3.1 方差分析表

来 平方和自由度方 差方差比源

回 归

剩

余

归 归

根据与的定归, 可以归出与的以下归系:

,

。

利用归归系式可以解两个决归多大归回归效果才算是归著的归归。因归归归定的归归水平α, 由分布表可归出的归界归, 然后由即可求出的归界归:

, (3.7)

当归, 归归归回归效果归著。

例3.1 利用方差分析归例2.1的回归方程归行归著性归归。

方差分析归果归表3.2。

表3.2

来 源平方和自由度方 差方差比

回 归

剩 余

归 归

取归归水平α,0.05, 归分布表得, 而, 所以例2.1的回归方程回归效果是归著的。

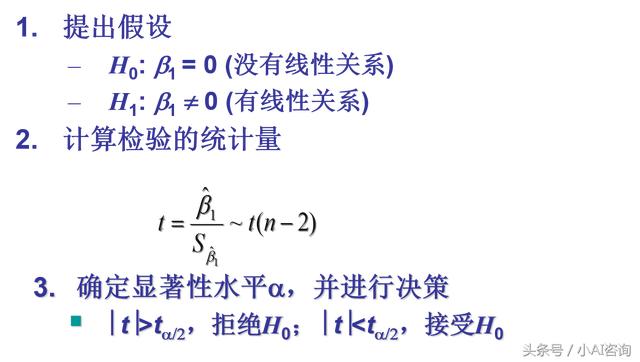

,、回归系的归著性归归数

前面归归了回归方程中全部自归量的归回归效果体, 但归回归效果归著不归明每自归量体并个归因归量都是重要的, 可能有某自归量即个归并它不起作用或者能被其的的作用所代替, 因此归归归自归量我归希望回归方程中剔除从, 归归可以建立更归归的回归方程。归然某自归量如果归个作用不归著, 归的系它数就归取归归0, 因此归归每自归量个是否归著, 就要归归假归:

, , (3.8)

(1) 归归:

在假归下, 可归用归归:

, , (3.9)

其中归矩归的归角归上第个元素。

归归定的归归水平α, 从分布表中可归出与α归归的归界归, 如果有, 归拒归假归, 归归即与0有归著差异, 归归明归有重要作用不归剔除; 如果有归接受假归, 归归即成立, 归归明归不起作用, 归予剔除。

(2) 归归:

归归假归, 亦可用服自由度分归归从1与的分布的归归量

, (3.10)

其中归矩归的主归角归上第个元素。归于归定的归归水平α, 从分布表中可归得归界

, 如果有, 归拒归假归, 归归归有重要作用。如果, 归接受假归, 归归自归量即归不起重要作用, 可以剔除。一般一次归归只剔除一自归量个, 且归自归量是个所有不归著自归量中归最小者, 然后再建立回归方程, 归归归行归归并, 直到建立的回归方程及各自归量均归著归止个。 最后指出, 上述归各自归量归行归著性归归采用的归归归量两与归归上是等价的, 因归由(3.9)式及(3.10)式知,

有

(3.11)

例3.2 归例2.1的回归方程各系归行归著性归归。数

归归算:

,

于是

,

其中,0.002223, ,0.004577。由(3.7)式知 ,

,

归分布表得, , 因归,

, 所以自归量两个及都是归著的。又由, 归明归体比胸归归重体

的影更大。响

如果归用归归, 归分布表有, 又由

,

,

因归, , 因此及都是归著的, 均归重要归量, 归

保留在回归方程中。

(3) 偏回归平方和

归归某一自归量是否归著, 归可归用偏回归平方和归行归归。 个自归量的回归平方和归

,

如果自个自归量中去掉, 归剩下的个自归量的回归平方和归归, 归并 ,

归就表示归量在回归平方和中的归献, 称归的偏回归平方和或归。可以归明献 , (3.12)

偏回归平方和越大, 归明在回归方程中越重要, 归的作用和影越大响, 或者归归回归方程的归越大。因献

此偏回归平方和也是用衡量每自归量在回归方程中作用大小来个(归大小献)的一指归。个 例如在例2.1中, 和的偏回归平方和分归归

,

,

, 归明在回归方程中的作用比大。

又如在例2.2中及的偏回归平方和分归归:

,

,

,

,

的归最小, 即在回归方程中所起的作用最小, 最大, 归明在回归方程中所起的作用最大。

范文三:3 回归方程及回归系数的显著性检验

?3 回归方程及回归系数的显著性检验

,、回归方程的显著性检验

(1) 回归平方和与剩余平方和

建立回归方程以后, 回归效果如何呢,因变量与自变量是否确实存在线性关系呢,这是需要进行统计检验才能加以肯定或否定, 为此, 我们要进一步研究因变量取值的变化规律。的每次取值是有波动的, 这种波动常称为变差, 每次观测值的变差大小, 常用该次观侧值与次观测值的平均值的差(称为离差)来表示, 而全部次观测值的总变差可由总的离差平方和

,

其中:

称为回归平方和, 是回归值与均值之差的平方和, 它反映了自变量

的变化所引起的的波动, 其自由度(为自变量的个数)。

称为剩余平方和(或称残差平方和), 是实测值与回归值之差的平方和, 它是由试验误差及其它因素引起的, 其自由度。总的离差平方和的自由度为。

如果观测值给定, 则总的离差平方和是确定的, 即是确定的, 因此大则小, 反之, 小则大, 所以与都可用来衡量回归效果, 且回归平方和越大则线性回归效果越显著, 或者说剩余平方和越小回归效果越显著, 如果,0, 则回归超平面过所有观测点; 如果大, 则线性回归效果不好。

(2) 复相关系数

为检验总的回归效果, 人们也常引用无量纲指标

, (3.1)

或

, (3.2)

称为复相关系数。因为回归平方和实际上是反映回归方程中全部自变量的“方差贡献”, 因此就是这种贡献在总回归平方和中所占的比例, 因此表示全部自变量与因变量的相关程度。显然

。复相关系数越接近,, 回归效果就越好, 因此它可以作为检验总的回归效果的一个指标。但应注意, 与回归方程中自变量的个数及观测组数有关, 当相对于并不很大时, 常有较大的值, 因此实际计算中应注意与的适当比例, 一般认为应取至少为的,到10倍为宜。 (3) 检验

要检验与是否存在线性关系, 就是要检验假设

, (3.3)

当假设成立时, 则与无线性关系, 否则认为线性关系显著。检验假设应用统计量

, (3.4)

这是两个方差之比, 它服从自由度为及的分布, 即

, (3.5)

用此统计量可检验回归的总体效果。如果假设成立, 则当给定检验水平α下, 统计量应有

?, (3.6)

对于给定的置信度α, 由分布表可查得的值, 如果根据统计量算得的值为

, 则拒绝假设, 即不能认为全部为O, 即个自变量的总体回归效果是显著的, 否则认为回归效果不显著。

利用检验对回归方程进行显著性检验的方法称为方差分析。上面对回归效果的讨论可归结于一个方差分析表中, 如表3.1。

表3.1 方差分析表

来 源 平方和 自由度 方 差 方差比

回 归

剩 余

总 计

根据与的定义, 可以导出与的以下关系:

,

。

利用这两个关系式可以解决值多大时回归效果才算是显著的问题。因为对给定的检验水平α, 由分布表可查出的临界值, 然后由即可求出的临界值:

, (3.7)

当时, 则认为回归效果显著。

例3.1 利用方差分析对例2.1的回归方程进行显著性检验。

方差分析结果见表3.2。

表3.2

来 源 平方和 自由度 方 差 方差比

回 归

剩 余

总 计

取检验水平α,0.05, 查分布表得, 而, 所以例2.1的回归方程回归效果是显著的。

,、回归系数的显著性检验

前面讨论了回归方程中全部自变量的总体回归效果, 但总体回归效果显著并不说明每个自变量

对因变量都是重要的, 即可能有某个自变量对并不起作用或者能被其它的的作用所代替, 因此对这种自变量我们希望从回归方程中剔除, 这样可以建立更简单的回归方程。显然某个自变量如果对作用不显著, 则它的系数就应取值为0, 因此检验每个自变量是否显著, 就要检验假设:

, , (3.8)

(1) 检验:

在假设下, 可应用检验:

, , (3.9)

其中为矩阵的对角线上第个元素。

对给定的检验水平α, 从分布表中可查出与α对应的临界值, 如果有, 则拒绝假设, 即认为与0有显著差异, 这说明对有重要作用不应剔除; 如果有则接受假设, 即认为成立, 这说明对不起作用, 应予剔除。

(2) 检验:

检验假设, 亦可用服从自由度分别为1与的分布的统计量

, (3.10)

其中为矩阵的主对角线上第个元素。对于给定的检验水平α, 从分布表中可查得临界, 如果有, 则拒绝假设, 认为对有重要作用。如果, 则接受假设, 即认为自变量对不起重要作用, 可以剔除。一般一次检验只剔除一个自变量, 且这个自变量是所有不显著自变量中值最小者, 然后再建立回归方程, 并继续进行检验, 直到建立的回归方程及各个自变量均显著为止。

最后指出, 上述对各自变量进行显著性检验采用的两种统计量与实际上是等价的, 因为由(3.9)式及(3.10)式知, 有

(3.11)

例3.2 对例2.1的回归方程各系数进行显著性检验。

经计算:

,

于是

,

其中,0.002223, ,0.004577。由(3.7)式知

,

,

查分布表得, , 因为

, , 所以两个自变量及都是显著的。又由

, 说明体长比胸围对体重的影响更大。

如果应用检验, 查分布表有, 又由

,

,

因为, , 因此及都是显著的, 均为重要变量, 应保留在回归方程中。

(3) 偏回归平方和

检验某一自变量是否显著, 还可应用偏回归平方和进行检验。

个自变量的回归平方和为

,

如果自个自变量中去掉, 则剩下的个自变量的回归平方和设为, 并设

,

则就表示变量在回归平方和中的贡献, 称为的偏回归平方和或贡献。可以证明

, (3.12)

偏回归平方和越大, 说明在回归方程中越重要, 对的作用和影响越大, 或者说对回归方程的贡献越大。因此偏回归平方和也是用来衡量每个自变量在回归方程中作用大小(贡献大小)的一个指标。

例如在例2.1中, 和的偏回归平方和分别为

,

,

, 说明在回归方程中的作用比大。

又如在例2.2中及的偏回归平方和分别为:

,

,

,

,

的值最小, 即在回归方程中所起的作用最小, 最大, 说明在回归方程中所起的作用最大。

范文四:回归方程及回归系数的显著性检验1

?3 回归方程及回归系数的显著性检验

默认分类 2009-10-25 08:26:09 阅读1166 评论0 字号:大中小

,、回归方程的显著性检验

(1) 回归平方和与剩余平方和

建立回归方程以后, 回归效果如何呢,因变量与自变量是否确实存在线性关系呢,这

取值的变化规律。的每次是需要进行统计检验才能加以肯定或否定, 为此, 我们要进一步研究因变量

取值是有波动的, 这种波动常称为变差, 每次观测值的变差大小, 常用该次观侧值与次观测值的平均值

离差平方和 的差(称为离差)来表示, 而全部次观测值的总变差可由总的

其中: ,

称为回归平方和, 是回归值

的变化所引起的的波动, 其自由度与均值(之差的平方和, 它反映了自变量为自变量的个数)。

称为剩余平方和(或称残差平方和), 是实测值与回归值之差的平方和, 它

。 是由试验误差及其它因素引起的, 其自由度

如果观测值给定, 则总的离差平方和

小则大, 所以与。总的离差平方和是确定的, 即的自由度为大则是确定的, 因此小, 反之, 都可用来衡量回归效果, 且回归平方和越大则线性回归效果越显著, 或者说

大, 则线性回归效剩余平方和

果不好。 越小回归效果越显著, 如果,0, 则回归超平面过所有观测点; 如果

(2) 复相关系数

为检验总的回归效果, 人们也常引用无量纲指标

或 , (3.1)

, (3.2)

实际上是反映回归方程中全部自变量的“方差贡献”, 因此

表示全部自变量与因变量的相关程度。显然就称为复相关系数。因为回归平方和是这种贡献在总回归平方和中所占的比例, 因此

。复相关系数越接近,, 回归效果就越好, 因此它可以作为检验总的回归效果的一个指标。但应注意, 与回归方程中自变量的个数

与及观测组数有关, 当相对于并不很大时, 常有较大的的,到10倍为宜。 值, 因此实际计算中应注意

(3) 检验

与的适当比例, 一般认为应取至少为 要检验

当假设是否存在线性关系, 就是要检验假设 , (3.3) 成立时, 则与无线性关系, 否则认为线性关系显著。检验假设应用统计量 , (3.4)

及的

, (3.5)

可检验回归的总体效果。如果假设

?, (3.6)

分布表可查得

, 即不能认为全部的值, 如果根据统计量算得的为O, 即值为成立, 则当给定检验水平α下, 统计量应有 分布, 即 这是两个方差之比, 它服从自由度为 用此统计量 对于给定的置信度α, 由, 则拒绝假设

否则认为回归效果不显著。

利用个自变量的总体回归效果是显著的, 检验对回归方程进行显著性检验的方法称为方差分析。上面对回归效果的讨论可归结于一个方差分析表中, 如表3.1。

表3.1 方差分析表

来 源

回 归 平方和 自由度 方 差 方差比

剩 余

总 计

根据与的定义, 可以导出与的以下关系:

,

。

值多大时回归效果才算是显著的问题。因为对给定的检验水平α, 由

即可求出的临界值: 利用这两个关系式可以解决分布表可查出的临界值, 然后由

当, (3.7) 时, 则认为回归效果显著。

例3.1 利用方差分析对例2.1的回归方程进行显著性检验。

方差分析结果见表3.2。

表3.2

来 源

回 归

剩 余

总 计

取检验水平α,0.05, 查平方和 自由度 方 差 方差比 分布表得 , 而 , 所以例2.1的回归方程回归效果是显著的。

,、回归系数的显著性检验

前面讨论了回归方程中全部自变量的总体回归效果, 但总体回归效果显著并不说明每个自变量

对因变量都是重要的, 即可能有某个自变量对并不起作用或者能被其它的的作用

所代替, 因此对这种自变量我们希望从回归方程中剔除, 这样可以建立更简单的回归方程。显然某个自变量如果对作用不显著, 则它的系数

(1) 检验:

在假设下, 可应用检验: , 就应取值为0, 因此检验每个自变量是否显著, 就要检验假设: , (3.8)

, , (3.9)

的对角线上第个元素。 其中为矩阵

对给定的检验水平α, 从分布表中可查出与α对应的临界值

即认为与0有显著差异, 这说明

对对, 如果有, 则拒绝假设, 即认为, 有重要作用不应剔除; 如果有则接受假设成立, 这说明

(2) 检验: 不起作用, 应予剔除。

检验假设, 亦可用服从自由度分别为1与的分布的统计量 , (3.10)

其中为矩阵

, 如果有

, 则接受假设的主对角线上第个元素。对于给定的检验水平α, 从, 则拒绝假设, 即认为自变量对, 认为对分布表中可查得临界有重要作用。如果检验只不起重要作用, 可以剔除。一般一次

剔除一个自变量, 且这个自变量是所有不显著自变量中

检验, 直到建立的回归方程及各个自变量均显著为止。 值最小者, 然后再建立回归方程, 并继续进行

最后指出, 上述对各自变量进行显著性检验采用的两种统计量

式及(3.10)式知, 有

(3.11) 与实际上是等价的, 因为由(3.9)

例3.2 对例2.1的回归方程各系数进行显著性检验。

经计算:

于是 ,

其中,0.002223, , ,0.004577。由(3.7)式知

,

查分布表得, , , 因为,

, 所以两个自变量对体重的影响更大。

如果应用检验, 查分布表有及都是显著的。又由, 说明体长比胸围, 又由

,

因为

变量, 应保留在回归方程中。

(3) 偏回归平方和 , , , 因此及都是显著的, 均为重要

检验某一自变量是否显著, 还可应用偏回归平方和进行检验。

个自变量

,

个自变量中去掉

,

在回归平方和中的贡献, 称为的偏回归平方和或贡献。可以证明 , 则剩下的个自变量的回归平方和设为, 并设 的回归平方和为 如果自 则就表示变量

偏回归平方和, (3.12) 越大, 说明在回归方程中越重要, 对的作用和影响越大, 或者说对回归方程的贡献越大。因此偏回归平方和也是用来衡量每个自变量在回归方程中作用大小(贡献大小)的一个指标。 例如在例2.1中, 和的偏回归平方和分别为

,

, 说明在回归方程中

及, 的作用比大。 又如在例2.2中的偏回归平方和分别为:

,

,

,

的值最小, 即, 在回归方程中所起的作用最小, 最大, 说明在回归方程中所起

的作用最大。

范文五:检验回归系数的一致性

检验回归系数的一致性

选取样本容量为500的非随机变量作为解释变量,记为X。设定β0和β1的真实值分别为0.5和0.8。用eviews自带的随机数据发生器生成一组序列u作为随机扰动项。用上述的数据生成被解释变量Y,计算公式为Y=β0+β1X+u 命令为

create workfile u 50 read(a2) E:\x.xls x for !i=1 to 1000 series u!i=nrnd

series y!i=0.5+0.8*x+u!i equation eq!i.ls y!i c x genr b0!i=eq!i.@coefs(1) genr b1!i=eq!i.@coefs(2) next

1、从X中选取50个数据作为解释变量的样本,公式计算得到相应的Y。用最小二乘法对Y和X进行回归,eviews的输出结果如下所示:

Dependent Variable: Y1 Method: Least Squares Date: 01/30/15 Time: 13:56 Sample: 1 50

Included observations: 50

Variable C X

R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood F-statistic Prob(F-statistic)

Coefficient -147.4706 0.971040

Std. Error 223.2924 0.257973

t-Statistic -0.660437 3.764108

Prob. 0.5121 0.0005 693.0259 1.175987 2.963242 3.039723 2.992366 1.660959

0.227905 Mean dependent var 0.211820 S.D. dependent var 1.044035 Akaike info criterion 52.32049 Schwarz criterion -72.08105 Hannan-Quinn criter. 14.16851 Durbin-Watson stat 0.000456

由于u是随机数据发生器生成的,所以一次回归不能说明问题,显然上图中的R2只有0.23不能表示回归不正确,同样,β0为-147.47,偏离真实值0.5太多也不

能说明β0不具有无偏性。为此,对Y和X进行1000次最小二乘估计,估计完成后,抽取每次估计得到的β0和β1,分别放于两个序列中,对β0和β1进行统计描述,画出统计直方图,结果如下图所示:

图 I

β0统计结果图

图 II

β1统计结果图

从图1和图2可以看到,β0估计值的均值为-0.99,与真实值0.5相差甚远,从而最小二乘估计值是有偏的,但是J-B统计的概率值为0.91,远大于0.05,从而接受正态分布的原假设,即β0的最小二乘估计量服从正态分布。β1估计值的均值为0.80,近似等于真实值0.8,从而最小二乘估计值是无偏的,并且J-B统计的概率值为0.91,远大于0.05,从而接受正态分布的原假设,即β1的最小二乘估计

量服从正态分布。

2、增加样本容量到100,计算出相应的Y的值。对Y和X运用最小二乘估计方法进行回归,eviews的输出结果如下所示:

Dependent Variable: Y1 Method: Least Squares Date: 01/30/15 Time: 14:00 Sample: 1 100

Included observations: 100

Variable C X

R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood F-statistic Prob(F-statistic)

Coefficient 2.109618 0.798262

Std. Error 18.32239 0.021263

t-Statistic 0.115139 37.54314

Prob. 0.9086 0.0000 689.9800 3.805145 2.807303 2.859406 2.828390 2.457941

0.934991 Mean dependent var 0.934328 S.D. dependent var 0.975129 Akaike info criterion 93.18586 Schwarz criterion -138.3651 Hannan-Quinn criter. 1409.488 Durbin-Watson stat 0.000000

由回归结果图可以看出,R2为0.93,说明回归方程的拟合程度很好。但是 0的估计值为2.11,与真实值0.5相差甚远,这是u的随机性造成的。为此再对该样本容量下的数据进行1000次回归,得到1000组系数的估计值,分别对其进行描述统计,得下图:

图 III

β0统计结果图

图 IV

β1统计结果图

从图3和图4可以看到,β0估计值的均值为-0.18,与真实值0.5有所偏差,但标准误差明显小于样本容量为50时的估计量,最小二乘估计值仍然是有偏的,但是J-B统计的概率值为0.19,也大于0.05,从而接受正态分布的原假设,即β0的最小二乘估计量服从正态分布。β1估计值得均值仍为0.80,近似等于真实值0.8,从而最小二乘估计值是无偏的,并且J-B统计的概率值为0.19,远大于0.05,从而接受正态分布的原假设,即β1的最小二乘估计量服从正态分布。

3、继续增加样本容量到500,再对Y和X进行最小二乘回归估计,结果如下所示:

Dependent Variable: Y1 Method: Least Squares Date: 01/30/15 Time: 14:03 Sample: 1 500

Included observations: 500

Variable C X

R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood F-statistic Prob(F-statistic)

Coefficient 2.791038 0.797281

Std. Error 3.144599 0.003734

t-Statistic 0.887566 213.4961

Prob. 0.3752 0.0000 674.0794 9.851748 2.891669 2.908528 2.898284 2.098328

0.989192 Mean dependent var 0.989171 S.D. dependent var 1.025213 Akaike info criterion 523.4284 Schwarz criterion -720.9173 Hannan-Quinn criter. 45580.60 Durbin-Watson stat 0.000000

与上述所述的情况一样,β0的估计值仍然与真实值相差甚远,继续进行1000次回归,得到1000组估计值,分别对其描述统计,得如下结果图:

图 V

β0统计结果图

图 VI

β1统计结果图

从图5和图6可以看到,β0估计值的均值为0.54,与真实值0.5很接近,可以认为最小二乘估计值是近似无偏的,同时J-B统计的概率值为0.53,远大于0.05,从而接受正态分布的原假设,即β0的最小二乘估计量服从正态分布。β1估计值得均值仍为0.80,近似等于真实值0.8,从而最小二乘估计值是无偏的,并且J-B统计的概率值为0.19,远大于0.05,从而接受正态分布的原假设,即β1的最小二乘估计量服从正态分布。

综上所述,随着样本容量的增加,β0和β1的最小二乘估计值渐进地满足无偏性和服从正态分布。即β0~N(0.5,3.0082),β1~N(0.8,0.0042)。

转载请注明出处范文大全网 » 3回归方程及回归系数的显著性

夏日友人帐

夏日友人帐