范文一:[船闸的工作原理]网闸工作原理

[船闸的工作原理]网闸工作原理

篇一 : 网闸工作原理

物理隔离网闸简介

二零零四年三月

目录

1.

2.

3.

4.

5.

6. 物理隔离网闸的定

位 ....................................................................................................................................3 物理隔离要解决的问

题................................................................................................................................3 TCP/IP的漏

洞 ...............................................................................................................................................3 防火墙的漏

洞..................................................................................................................................................4 物理隔离的技术原

理 ................................................................................................................

....................4 物理隔离网闸常见技术问题解

答 ..............................................................................................................8

6.1.

6.2.

6.3.

6.4.

6.5.

6.6.

6.7.

6.8.

6.9. 物理隔离网闸一定要采用专用开关集成电路吗,......................................................................8 物理隔离网闸是如何利用SCSI来实现开关技术

的, ..............................................................9 物理隔离网闸可以采用USB,火线和以太来实现软开关吗,...............................................9 为什么SCSI可以,而USB、火线和以太就不行, ................................................................10 物理隔离网闸的开关的速度很慢

吗, ..........................................................................................10 物理隔离网闸工作在OSI模型的那一层, ................................................................................10 物理隔离网闸在OSI模型第5层是如何工作

的, ...................................................................11 物理隔离网闸在OSI

模型第七层是如何工作

的, ...................................................................12 信息安全交换系统

是如何工作

的, ..............................................................................................12

6.10. 安全隔离网闸在OSI模型里是如何工

作, ................................................................................13

6.11. 采用了协议转换,是物理隔离

吗, ..............................................................................................15

6.12. 基于协议转换的双主机结构有哪些类型和形

式,....................................................................15

6.13. 物理隔离网闸的每一个应用都需要相应的代

理,....................................................................17

6.14. 物理隔离网闸的应用代理是否符合相关的RFC规

范, .........................................................17

6.15. 从外网已经PING不通内网,是物理隔离网闸

吗, ..................................................................17

6.16. 从外网无法扫描内网的主机,是物理隔离网闸

吗, ...............................................................18

6.17. 通过开关来实现了包转发,是物理隔离网闸

吗,....................................................................18

6.18. 为什么说即使入侵了网闸的外部主机,也无法入侵内部

主机, .........................................18

6.19. 物理隔离网闸的外部主机有哪些防止入侵的办

法, ...............................................................18

6.20. 为什么物理隔离网闸能阻止未知的攻

击, .................................................................................19

6.21. 物理隔离网闸的安全性是最高的

吗, ..........................................................................................19

1. 物理隔离网闸的定位

物理隔离技术,不是要替代防火墙,入侵检测,漏洞扫描和防

病毒系统,相反,它是用户“深度防御”的安全策略的另外一块基石,

一般用来保护为了的“核心”。其中安全性最高的一种如下图。

Page 13 of 19

但没有发现这种结构与单个的代理有本质的不同,除非内部主

机的操作系统与外部的不同。因此,有些厂商,将以太线改为串口,

并口,USB或火线,有的干脆在USB或火线上跑TCP/IP协议。总体

上,可以归纳为,双主机之间有通信协议,甚至是TCP/IP协议,某

些情况下,包直接从外部主机到达内部主机,可能发生基于包的攻击,

某些情况下,可能发生基于连接的攻击,某些情况下,可能发生基于

命令的攻击等。因此,基于私有通信协议并不意味着安全。

有些厂商为了增加对内容的检查,利用TCP Stream来还原数据流,以便增加对内容的检查。在防火墙上同样可以增加这些功能。如有厂商推出流过滤,就是这样一个功能。这只是上图的一个变种,同样存在基于连接的攻击,基于会话的攻击,和基于协议的攻击。

Page 16 of 19

这是另外一个变种,在双主机上利用应用代理来增强安全性,消除了利用协议漏洞攻击的可能性,但还是存在基于通信连接攻击的可能性。[,因此上述情况都不是物理隔离网闸。

6.13. 物理隔离网闸的每一个应用都需要相应的代理,

答:是。除了标准通用应用之外,每一个应用只要有协议规范,就可以定制。因此任何行业都可以使用物理隔离网闸,不管其应用多特殊。

6.14. 物理隔离网闸的应用代理是否符合相关的RFC规范,

答:符合。只有符合,才能保证应用的透明性和互通性。

6.15. 从外网已经ping不通内网,是物理隔离网闸吗,

答:不一定。Ping当然无法ping通物理隔离网闸,但ping不通不一定是物理隔离网闸。在路由器上禁止ICMP协议,ping就不能工作,但不是物理隔离网闸。

Page 17 of 19

6.16. 从外网无法扫描内网的主机,是物理隔离网闸吗,

答:不一定。(]扫描软件无法通过物理隔离网闸来扫描内部主

机,但扫描不了内部主机不一定就是物理隔离网闸。扫描软件就无法通过代理服务器来扫描内部主机,但代理服务器不是物理隔离网闸。

6.17. 通过开关来实现了包转发,是物理隔离网闸吗,

答:不是。只要包里含有TCP/IP协议,即使是使用了开关,也可以建立TCP连接。存在基于包和TCP协议的攻击。

6.18. 为什么说即使入侵了网闸的外部主机,也无法入侵内部主机,

答:物理隔离网闸的外部主机和内部主机不是通过对话来进行通信的,而是不对话不通信,只根据“好的”约定来进行简单的动作。比如说,在最坏的可能的情况下,黑客入侵了外部主机,黑客也可以人工的向固态存储介质写文件,内部主机拿到这些文件后,内部应用不能理解这些文件,只好丢掉,即使理解了,发现不符合安全政策,也是丢掉。内部主机的决策不是由外部主机发来的文件决定,而是根据内部的安全政策决定。因此,不可能控制内部。加上没有连接,没有通信,没有协议,不可能入侵内部。

6.19. 物理隔离网闸的外部主机有哪些防止入侵的办法,

答:外部主机因为要提供服务,必须准许访问。从绝对的技术观点上来讲,没有操作系统保证说我这个操作系统没有漏洞,因此,在理论上外部主机存在被攻击的可能性,哪怕是千万分之一的小概率事件。这并不意味着外部主机就一定会被攻击。有很多的技术手段可以保证即使在操作系统有漏洞的情况下,也无法让黑客入侵,如轻量级入侵检测,关闭登录主机服务,隐蔽性防配置文件被窜改,等很多

措施,可以将外部主机被入侵的风险降至最低。

Page 18 of 19

6.20. 为什么物理隔离网闸能阻止未知的攻击,

答:目前发现的攻击,按照分类,有基于应用协议漏洞的,有基于TCP/IP协议漏洞的,有基于命令的,有基于包的。

>>

范文二:B超的工作原理,CT工作原理

B 超的成像原理 为:

将回声信号显示为光点,回声的强弱以点的灰(亮)度显示。声阻抗相差越大,反射越强,产生的回声信号越亮,反之 越弱,产生的回声信号越暗,当探头在体表快速顺序移动, 则产生一行行亮点, 组成一个平面,即显示一个断面的图象, 称为二维切面图象 1

CT工作原理

CT的基本原理是图像重建,根据人体各种组织(包括正常和异常组织)对 X 射线吸收不等这一特性,将人体某一选定层面分成许多立方体小块(也称体素) X 射线穿过体素后,测得的密度或灰度值称为像素。 X 射线束穿过选定层面,探 测器接收到沿 X 射线束方向排列的各体素吸收 X 射线后衰减值的总和, 为已知值, 形成该总量的各体素 X 射线衰减值为未知值, 当 X 射线发生源和探测器围绕人体 做圆弧或圆周相对运动时。 用迭代方法求出每一体素的 X 射线衰减值并进行图像 重建,得到该层面不同密度组织的黑白图像。

。 CT 机扫描部分主要由 X 线管和不同数目的控测器组成,用来收集 信息。 X 线束对所选择的层面进行扫描, 其强度因和不同密度的组织 相互作用而产生相应的吸收和衰减。探测器将收集到 X 线信号转变 为电信号,经模/数转换器(A /D converter)转换成数字,输入计 算机储存和处理, 从而得到该层面各单位容积的 CT 值 (CT number) , 并排列成数字矩阵 (Digital matrix) (图 7-2) 。 这些数字可储存于硬 磁盘(Hard disk) 、软磁盘(Floppy )和磁带(Magnetic tape,MT) 中,也可用打印机印用。数字矩阵经数/模(D/A)转换器在监视器 上转为图像, 即为该层的横断图像。 图像可用多幅照相机摄于胶片上, 供读片、存档和会诊用。

范文三:RFID技术的工作原理

RFID 技术的工作原理

RFID 技术的基本工作原理并不复杂:标签进入磁场后,接收解读器发出的射频信号,凭借感应电流所获得的能量发送出存储在芯片中的产品信息(Passive Tag ,无源标签或被动标签),或者由标签主动发送某一频率的信号(Active Tag,有源标签或主动标签),解读器读取信息并解码后,送至中央信息系统进行有关数据处理。

一套完整的RFID 系统, 是由阅读器(Reader )与电子标签(TAG )也就是所谓的应答器(Transponder )及应用软件系统三个部份所组成,其工作原理是Reader 发射一特定频率的无线电波能量给Transponder ,用以驱动Transponder 电路将内部的数据送出,此时 Reader 便依序接收解读数据, 送给应用程序做相应的处理。

以RFID 卡片阅读器及电子标签之间的通讯及能量感应方式来看大致上可以分成:感应耦合(Inductive Coupling ) 及后向散射耦合(Backscatter Coupling )两种。一般低频的RFID 大都采用第一种式,而较高频大多采用第二种方式。

阅读器根据使用的结构和技术不同可以是读或读/写装置,是RFID 系统信息控制和处理中心。阅读器通常由耦合模块、收发模块、控制模块和接口单元组成。阅读器和应答器之间一般采用半双工通信方式进行信息交换,同时阅读器通过耦合给无源应答器提供能量和时序。在实际应用中,可进一步通过Ethernet 或WLAN 等实现对物体识别信息的采集、处理及远程传送等管理功能。应答器是RFID 系统的信息载体,目前应答器大多是由耦合原件(线圈、微带天线等)和微芯片组成无源单元。

零售商推崇RFID 的原因

据Sanford C. Bernstein公司的零售业分析师估计,通过采用RFID ,沃尔玛每年可以节省83.5亿美元,其中大部分是因为不需要人工查看进货的条码而节省的劳动力成本。尽管另外一些分析师认为80亿美元这个数字过于乐观,但毫无疑问,RFID 有助于解决零售业两个最大的难题:商品断货和损耗(因盗窃和供应链被搅乱而损失的产品),而现在单是盗窃一项,沃尔玛一年的损失就差不多有20亿美元,如果一家合法企业的营业额能达到这个数字,就可以在美国1000家最大企业的排行榜中名列第694位。研究机构估计,这种RFID 技术能够帮助把失窃和存货水平降低25%。

RFID 技术的典型应用

物流和供应管理 生产制造和装配 航空行李处理 邮件/快运包裹处理 文档追踪/图书馆管理 动物身份标识 运动计时 门禁控制/电子门票

道路自动收费 城市一卡通的应用 高校手机一卡通的应用。 仓储中塑料托盘、周转筐中的应用

RFID 读写设备

只有当有读写设备时,RFID 才能发挥其作用。RFID 读写设备有RFID 读卡器,RFID 读写模块等。这些设备可以将RFID 的数据读取或写入,读卡器连接的识别系统有密钥芯片,能做到很好的加密。

范文四:dhcp的工作原理

1 引言

在传统的DHCP动态分配IP地址的方式中,同一VLAN的用户得到的IP地址所拥有的权限是完全相同的,网络管理者不能对同一LAN中特定的用户进行有效的控制。普通的DHCP中继代理(不支持Option82的)也不能够区分不同的客户端,从而无法结合DHCP动态分配IP地址的应用来控制客户端对网络资源的访问,给网络的安全控制提出了严峻的挑战。

利用DHCP的OPTOIN 82,通过与认证系统的配合,可以有效的动态的控制用户对网络特定资源的访问。 2 DHCP的工作原理

(1)寻找Server:当DHCP客户端第一次登录网络的时候,它会向网络广播一个DHCP DISCOVER数据包。

(2)提供IP租用地址:每个有空闲地址的DHCP服务器都发出DHCP OFFER包响应这个DHCP DISC0VER包。

(3)接受IP租约:如果客户端收到网络上多台DHCP服务器的回应,就会挑选其中一个DHCP Offer而已(通常是最先抵达的那个),并且会向网络发送一个DHCP Request广播数据包,告诉所有DHCP服务器它将指定接受哪一台服务器提供IP地址。同时,客户端还会向网络发送一个ARP数据包,查询网络上面有没有其它机器使用该IP地址;如果发现该IP已经被占用,客户端则会送出一个DHCP DECLINE数据包给DHCP服务器,拒绝接受其DHCP Offer,并重新发送DHCP Discover信息。事实上,并不是所有DHCP客户端都会无条件接受DHCP服务器的Offer。客户端也可以用DHCP Request向服务器提出DHCP选择,而这些选择会以不同的号码填写在DHCP Option Field里面。换句话说,在DHCP服务器上面的设定,未必是客户端全都接受,客户端可以保留自己的一些TCP/IP设定。

(4)租约确认:当DHCP服务器接收到客户端的DHCP Request之后,会向客户端发出一个DHCP ACK回应,以确认IP租约的正式生效,也就结束了一个完整的DHCP工作过程。

DHCP的工作流程如图1如示。

3 DHCP数据包格式

(1)OPTION字段:允许厂商定义选项(Vendor-SpecificArea),以提供更多的设定信息(如:Netmask、Gateway、DNS等等)。其长度可变,同时可携带多个选项,每一选项之第一个byte为资讯代码,其后一个byte为该项资料长度,最后为项目内容。

(2)DHCP Option 82:当DHCP Relay Agent将客户端的DHCP包转发到DHCP服务器时,可以插入一些选项信息,以便DHCP服务器能更精确的得知PC客户端的信息,从而能更灵活按相应策略分配IP地址和IP地址需要的租约时间。该选项信息的选项号为82,故又称为Option 82,相关标准文档为RFC 3046。Option 82是对DHCP选项的扩展应用,这个新的选项被称为:DHCP relay agent information option(中继代理信息选项),当向一个DHCP中继代理传输客户端发起的DHCP请求时被中继代理嵌入到客户端的DHCP报文中,当服务器识别到中继代理信息选项后就会根据选项中的信息执行IP地址的分配和策略的实施。

DHCP服务器将发给用户的响应数据包首先发送给中继代理,然后由中继代理将选项字段剥去后发送给客户端。

“中继信息”选项被定义为一个包含一个或多个“子选项”的单独的DHCP选项,并传送可被中继代理识别的信息。Option 82选项如同一个“容器”选项,为中继代理分配的特定的子选项在DHCP报文中提供了数据空间。

(3)Option 82选项格式:

其中,可填充的子选项个数最大为255个。

在初期的子选项中定义了用来标识源发送端链路的“Circuit ID”和向远程高速调制解调器提供的信任标识“REMOTE ID”。

通过将DHCP Option 82选项与实际的认证系统向结合,认证系统能够使用Option 82的Circuit ID和Remote ID子选项按不同的用户权限给用户分配不同的IP地址,一方面能更精确的进行IP地址管理,另一方面可以让交换机或路由器进行“源IP地址”的策略路由,从而最终达到不同IP地址有不同的路由规则、不同的上网权限的目的。

4 DHCP Option 82的应用

(1)Option 82工作原理

利用DHCP Option 82功能的中继代理,通过Option 82选项中的子选项Circuit ID值和Remote ID值,告诉DHCP服务器,可更具体的指出是交换机的哪种权限的用户发出的DHCP请求,以供DHCP服务器按相应策略分配IP地址或相应的租期。如图4所示。

在安全认证计费系统中配置了“用户权限”和“下传VLAN”参数(网络实施前,管理员规划好这些参数值),支持Option 82 功能的交换机会把这些信息分别做为Option 82中的“Circuit ID”和“Remote ID”子选项的值传给DHCP Server,这样 DHCP Server 就能根据不同的“用户权限”或不同的“VLAN ID参数”,按相应的配

置策略分配用户不同类型的 IP,再结合DHCP Server的IP授权模式,管理员就可以轻松的实现更精确的IP地址管理和IP的动态绑定管理。

(2)Option 82与认证系统的工作流程

通过DHCP服务器与认证服务器的配合,可以使校园网用户在通过认证服务器的认证后,根据认证服务器上不同用户所分配的不同权限与DHCP服务器的DHCP Option 82配合,使得DHCP服务器可以根据认证服务器所分配给用户的权限分配响应的IP地址给用户。其过程如图5所示。

工作过程分析:

?用户未认证前,未获得动态IP前,只有认证报文和DHCP报文可以通过交换机。用户开机,想上网,是无法成功的,首先获得一个上网权限很低的私有IP,该IP地址不能上外网,只能访问校内特定资源,如Web Portal服务器等特定的服务器,这样,可以控制为认证用户对特定网络资源的使用,保证了网络资源的安全。

?用户端向认证服务器发出认证请求,经过中继代理交换机的转发到达认证服务器。 ?认证服务器对用户的合法性进行认证之后,在下传用户认证通过的响应的同时下传在认证服务器上所设定的不同用户的不同的权限,同时,将权限写入DHCP Option 82字段内,并将此报文下传给中继交换机。 ?此时,认证通过的合法用户根据认证服务器下发的权限,将特定的将权限写入Option 82字段,向DHCP服务器发起请求。

?DHCP服务器根据用户Option 82字段中的特定的权限值向用户分配相应的IP地址。同时,在中继交换机上,做相应的动态的地址绑定,在保证用户合法性的同时,确保了用户的唯一性。 6 结束语

我校校园网使用了锐捷网络的RG-SAM?认证软件和STAR-S2126G/2150G交换机,通过DHCP Option 82功能实现了网络的安全和策略管理

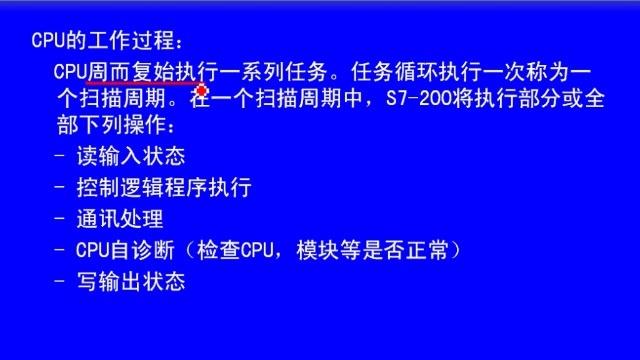

范文五:CPU的工作原理

CPU的工作原理 众所周知,CPU是电脑的“心脏”,是整个微机系统的核心,因此,它也往往成了各种档次微机的代名词,如昔日的286、386、486,奔腾、PⅡ、K6到今天的PⅢ、P4、K7、K8等。回顾CPU的发展历史,CPU在制造技术上已经获得了极大的提高,主要表现在集成的电子元件越来越多,从开始集成几千个晶体管,到现在的几百万、几千万个晶体管,这么多晶体管,它们是如何处理数据的呢?

CPU的原始工作模式

在了解CPU工作原理之前,我们先简单谈谈CPU是如何生产出来的。CPU是在特别纯净的硅材料上制造的。一个CPU芯片包含上百万个精巧的晶体管。人们在一块指甲盖大小的硅片上,用化学的方法蚀刻或光刻出晶体管。因此,从这个意义上说,CPU正是由晶体管组合而成的。简单而言,晶体管就是微型电子开关,它们是构建CPU的基石,你可以把一个晶体管当作一个电灯开关,它们有个操作位,分别代表两种状态:ON(开)和OFF(关)。这一开一关就相当于晶体管的连通与断开,而这两种状态正好与二进制中的基础状态“0”和“1”对应!这样,计算机就具备了处理信息的能力。

但你不要以为,只有简单的“0”和“1”两种状态的晶体管的原理很简单,其实它们的发展是经过科学家们多年的辛苦研究得来的。在晶体管之前,计算机依靠速度缓慢、低效率的真空电子管和机械开关来处理信息。后来,科研人员把两个晶体管放置到一个硅晶体中,这样便创作出第一个集成电路,再后来才有了微处理器。

看到这里,你一定想知道,晶体管是如何利用“0”和“1”这两种电子信号来执行指令和处理数据的呢?其实,所有电子设备都有自己的电路和开关,电子在电路中流动或断开,完全由开关来控制,如果你将开关设置为OFF,电子将停止流动,如果你再将其设置为ON,电子又会继续流动。晶体管的这种ON与OFF

的切换只由电子信号控制,我们可以将晶体管称之为二进制设备。这样,晶体管的ON状态用“1”来表示,而OFF状态则用“0”来表示,就可以组成最简单的二进制数。众多晶体管产生的多个“1”与“0”的特殊次序和模式能代表不同的情况,将其定义为字母、数字、颜色和图形。举个例子,十进位中的1在二进位模式时也是“1”,2在二进位模式时是“10”,3是“11”,4是“100”,5是“101”,6是“110”等等,依此类推,这就组成了计算机工作采用的二进制语言和数据。成组的晶体管联合起来可以存储数值,也可以进行逻辑运算和数字运算。加上石英时钟的控制,晶体管组就像一部复杂的机器那样同步地执行它们的功能。 CPU的内部结构

现在我们已经大概知道CPU是负责些什么事情,但是具体由哪些部件负责处理数据和执行程序呢?

1.算术逻辑单元ALU(Arithmetic Logic Unit)

ALU是运算器的核心。它是以全加器为基础,辅之以移位寄存器及相应控制逻辑组合而成的电路,在控制信号的作用下可完成加、减、乘、除四则运算和各种逻辑运算。就像刚才提到的,这里就相当于工厂中的生产线,负责运算数据。

2.寄存器组 RS(Register Set或Registers)

RS实质上是CPU中暂时存放数据的地方,里面保存着那些等待处理的数据,或已经处理过的数据,CPU访问寄存器所用的时间要比访问内存的时间短。采用寄存器,可以减少CPU访问内存的次数,从而提高了CPU的工作速度。但因为受到芯片面积和集成度所限,寄存器组的容量不可能很大。寄存器组可分为专用寄存器和通用寄存器。专用寄存器的作用是固定的,分别寄存相应的数据。而通用寄存器用途广泛并可由程序员规定其用途。通用寄存器的数目因微处理器而异。

3.控制单元(Control Unit)

正如工厂的物流分配部门,控制单元是整个CPU的指挥控制中心,由指令寄存器IR(Instruction Register)、指令译码器ID(Instruction Decoder)和操作控制器0C(Operation Controller)三个部件组成,对协调整个电脑有序工作极为重要。它根据用户预先编好的程序,依次从存储器中取出各条指令,放在指令寄存器IR中,通过指令译码(分析)确定应该进行什么操作,然后通过操作控制器OC,按确定的时序,向相应的部件发出微操作控制信号。操作控制器OC中主要包括节拍脉冲发生器、控制矩阵、时钟脉冲发生器、复位电路和启停电路等控制逻辑。

4.总线(Bus)

就像工厂中各部位之间的联系渠道,总线实际上是一组导线,是各种公共信号线的集合,用于作为电脑中所有各组成部分传输信息共同使用的“公路”。直接和CPU相连的总线可称为局部总线。其中包括: 数据总线DB(Data Bus)、地址总线AB(Address Bus) 、控制总线CB(Control Bus)。其中,数据总线用来传输数据信息;地址总线用于传送CPU发出的地址信息;控制总线用来传送控制信号、时序信号和状态信息等。

CPU的工作流程

由晶体管组成的CPU是作为处理数据和执行程序的核心,其英文全称

是:Central Processing Unit,即中央处理器。首先,CPU的内部结构可以分为控制单元,逻辑运算单元和存储单元(包括内部总线及缓冲器)三大部分。CPU的工作原理就像一个工厂对产品的加工过程:进入工厂的原料(程序指令),经过物资分配部门(控制单元)的调度分配,被送往生产线(逻辑运算单元),生产出成品(处理后的数据)后,再存储在仓库(存储单元)中,最后等着拿到市场上去卖(交由应用程序使用)。在这个过程中,我们注意到从控制单元开始,CPU

就开始了正式的工作,中间的过程是通过逻辑运算单元来进行运算处理,交到存储单元代表工作的结束。

数据与指令在CPU中的运行

刚才已经为大家介绍了CPU的部件及基本原理情况,现在,我们来看看数据是怎样在CPU中运行的。我们知道,数据从输入设备流经内存,等待CPU的处理,这些将要处理的信息是按字节存储的,也就是以8位二进制数或8比特为1个单元存储,这些信息可以是数据或指令。数据可以是二进制表示的字符、数字或颜色等等。而指令告诉CPU对数据执行哪些操作,比如完成加法、减法或移位运算。

我们假设在内存中的数据是最简单的原始数据。首先,指令指针

(Instruction Pointer)会通知CPU,将要执行的指令放置在内存中的存储位置。因为内存中的每个存储单元都有编号(称为地址),可以根据这些地址把数据取出,通过地址总线送到控制单元中,指令译码器从指令寄存器IR中拿来指令,翻译成CPU可以执行的形式,然后决定完成该指令需要哪些必要的操作,它将告诉算术逻辑单元(ALU)什么时候计算,告诉指令读取器什么时候获取数值,告诉指令译码器什么时候翻译指令等等。

假如数据被送往算术逻辑单元,数据将会执行指令中规定的算术运算和其他各种运算。当数据处理完毕后,将回到寄存器中,通过不同的指令将数据继续运行或者通过DB总线送到数据缓存器中。

基本上,CPU就是这样去执行读出数据、处理数据和往内存写数据3项基本工作。但在通常情况下,一条指令可以包含按明确顺序执行的许多操作,CPU的工作就是执行这些指令,完成一条指令后,CPU的控制单元又将告诉指令读取器从内存中读取下一条指令来执行。这个过程不断快速地重复,快速地执行一条又一条指令,产生你在显示器上所看到的结果。我们很容易想到,在处理这么多

指令和数据的同时,由于数据转移时差和CPU处理时差,肯定会出现混乱处理的情况。为了保证每个操作准时发生,CPU需要一个时钟,时钟控制着CPU所执行的每一个动作。时钟就像一个节拍器,它不停地发出脉冲,决定CPU的步调和处理时间,这就是我们所熟悉的CPU的标称速度,也称为主频。主频数值越高,表明CPU的工作速度越快。

如何提高CPU工作效率

既然CPU的主要工作是执行指令和处理数据,那么工作效率将成为CPU的最主要内容,因此,各CPU厂商也尽力使CPU处理数据的速度更快。

根据CPU的内部运算结构,一些制造厂商在CPU内增加了另一个算术逻辑单元(ALU),或者是另外再设置一个处理非常大和非常小的数据浮点运算单元(Floating Point Unit,FPU),这样就大大加快了数据运算的速度。 而在执行效率方面,一些厂商通过流水线方式或以几乎并行工作的方式执行指令的方法来提高指令的执行速度。刚才我们提到,指令的执行需要许多独立的操作,诸如取指令和译码等。最初CPU在执行下一条指令之前必须全部执行完上一条指令,而现在则由分布式的电路各自执行操作。也就是说,当这部分的电路完成了一件工作后,第二件工作立即占据了该电路,这样就大大增加了执行方面的效率。

另外,为了让指令与指令之间的连接更加准确,现在的CPU通常会采用多种预测方式来控制指令更高效率地执行。

转载请注明出处范文大全网 » [船闸的工作原理]网闸工作原

格林GG

格林GG